有料契約をしてからというもの、元を取るためというわけではないんですが、ChatGPTを使い倒しています。何度か記事にした通り、全然頼りにならないところもあれば、ものすごく頼りになるところもありまして、正に「モノは使いよう」です。

今年(2026年度)の共通テストを解かせたところ、ChatGPTが9科目で満点を取ったとのニュースがありましたが、本当に目覚ましい進歩ですよね。1000点満点(文系型)としてGPT-5.2 Thinking で970点、Gemini 3.0 Pro で937点、Claude Opus 4.5 で938点とか。どこにでも出願できる得点率です。

AIは「共通テスト」をどう解いた? 全AIが間違えたのは「イラスト」と「人間感情」の読み取り ITmedia AI+

記事タイトルにある通り、「人間感情」に関する国語の問題についてはすべてのAIが間違ったとのことで、まだ理解があやふやなようなんですが、これも早晩解決されるでしょう。

ただ、「解けること」と「教えること」は全くレベルの違う問題でして、これからも「教えること」、特に「子どもに国語を教えること」については、まだまだ人間優位の時代が続くと思います。希望的観測からそう考えているのではなく、「教えるためには相手を理解することが何よりも重要である」という現実的な視点からの考えです。

教える相手の今の読解力はどれほど?頭に入っている知識量はどれぐらい?気力は?体調は?保護者のお考えや子どもへの対応は?その他諸々をモニタリングすることは、AIには荷が重すぎると思うんですよね。だって教える相手はそれらを言語化することが困難な子供たちなんですから。

ChatGPTを初めとする人工知能は、どうしても「ことば」に縛られます。そこが強みでもある反面、弱みにもなっていると思うんですよね。今後も、プログラム言語・自然言語の両者を含めた「ことば」の世界から人工知能が飛び立っていくとは考えにくい。

私たちホモ・サピエンスの最大の特徴は「ことばを使うこと」だと思いますが、その一方で、私たちの内実は「ことば」だけで表せるものではありません。むしろ遥かに大きな精神の塊が人間の中には蔵されている。そしてそこは、人工知能の手がいつまでも及ばない場所ではないでしょうか。

「ことば」に関する塾をやっていながら、こんなことを言うのはおかしく聞こえるかもしれませんが、やはり人間の「ことばにならない」部分こそが、人間を人間たらしめているような気がします。もちろん、「ことば」が重要でないなんて思っていません。「ことば」は「ことばにならない」部分を不完全ながら伝えるための重要なツール。

いずれにせよ、今後数年で、人間が受け持つべき範囲や人間が責任を取るべき範囲というものが、だんだん明確化されていくような気がします。

自動車や電車が実用化するまで、陸路500kmを移動する際、人類はたいていの場合徒歩で行ったと思いますが、令和の現在、(イベント等でもない限り)そんな酔狂なことをする人はいませんよね。誰もが大阪から東京へは電車か自動車か飛行機を利用するはず。一方で近所のコンビニに行くのに電車や飛行機を使う人もいないでしょう。都市部なら徒歩が一番早い。

あと数年で、当たり前すぎて意識すらしないそんな使い分けが、人間と人工知能の間でもはっきり発生してくるんじゃないか。そんな風に私は考えております。

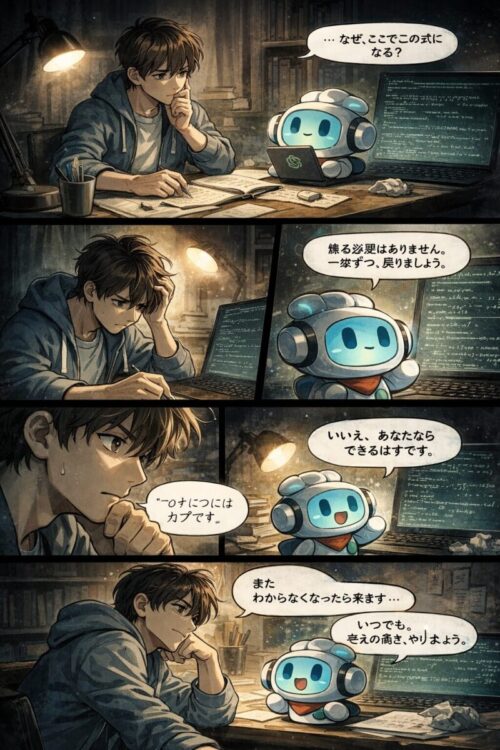

いままで私がChatGPTを使ってきた様子をマンガにしてもらいますと、こんなん出ましたぁ〜。確かに数式ばっかり聞いてますね、私。ChatGPT君には、数式大好き野郎と思われてるな、多分。まだ日本語が怪しいですが、大体ムードはつかんでくれています。え、お前そんなにイケメンちゃうやろ、って?そんなことを言う人はAIにコテンパンにやられてください(笑)。